Vídeos pornográficos falsos con caras de personas reales: Un abogado explica qué hacer si apareces en uno

Un experto en derecho digital analiza en La Tarde el caso de la streamer QTCinderella: usaron su cara y crearon un vídeo porno falso mediante una IA

Madrid - Publicado el - Actualizado

1 min lectura

Los 'deep fake' son vídeo hiperrealistas en los que crees estar viendo a una persona que en realidad no es, es falso. Su número se duplica cada 6 meses, acaparan más de 130 millones de visualizaciones y el 90% de estos vídeos son pornografía creada por inteligencia artificial y sin el consentimiento de las personas afectadas. Imagínate que alguien coge unas imágenes tuyas de internet y, con ellas, crea un vídeo pornográfico en el que parece que eres tú el que está ahí, y ese vídeo comienza a correr por redes sociales.

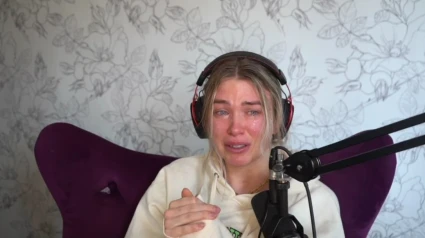

Un caso ha sido el de la creadora de contenidos QTCinderella, que ha denunciado la situación entre lágrimas y dolor, y que cuenta que han creado una secuencia pornográfica con Inteligencia Artifical en la que todo es falso, salvo el daño que le han creado a ella. “Esta la imagen del dolor”. Borja Adsuara, abogado y experto en derecho digital y en protección de datos, ha analizado las consecuencias en La Tarde, ya no sólo de este caso, sino de cualquier escenario en el que, incluso una persona anónima (compañera de trabajo o amiga) puede ser víctima.